Her yeni veri seti, model ve yapay zekâ ajanı; olağanüstü fırsatlarla birlikte tamamen yeni riskleri de beraberinde getiriyor. Kurumlar bugüne dek bu ölçekte ve bu denli özerk çalışan teknolojileri güvence altına almak zorunda kalmamıştı. Bu nedenle Prisma® AIRS™ 2.0, kurumları tehditlerin bir adım ödesinde tutmak amacıyla özel olarak tasarlandı. Platform, yapay zekâ ekosisteminizin tamamına net bir görünürlük sunuyor, ortaya çıkan riskleri değerlendirmenize yardımcı oluyor ve yapay zekâya özgü tehditlere karşı savunma sağlıyor.

Kısa süre önce Palo Alto Networks tarafından satın alınan Protect AI’ın entegrasyonunun tamamlanmasıyla birlikte gelen bu büyük platform upgrade’i ile ölçeklenebilir ve güvenli yapay zekâ inovasyonu için birleşik ve sürdürülebilir bir temel oluşturulmuş oldu.

AI Agent ve MCP Güvenliği: Özerk Dijital İş Gücünü Güvence Altına Almak

Yapay zekâ ajanları, günümüzde Microsoft 365 Copilot ve Salesforce gibi platformların içine gömülü bir şekilde işletmelerin iş süreçlerine dahil oluyor ve kurumsal otomasyonun yeni dalgasını yönlendiriyor. Ancak geniş erişim yetkileri ve görece sınırlı denetimleri nedeniyle ajanlar, kurumlar için benzersiz güvenlik riskleri de yaratıyor. Prompt injection, bağlam zehirleme, araç kötüye kullanımı ve hafıza manipülasyonu gibi saldırılar, ajanların amaç dışı, uygunsuz veya güvensiz davranışlar sergilemesine yol açabiliyor.

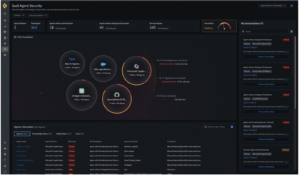

Prisma AIRS AI Agent Security, işletmelerin yapay zekâ ajanlarını SaaS uygulamalarından çalışma zamanı ortamlarına kadar her ortamda görünür hale getirmesini, kontrol etmesini ve güvence altına almasını sağlıyor. Platform, ajanlar çalışmaya başlamadan önce mevcut yapılandırmalarını analiz ediyor; kimlik, erişim ve bağlantı ilişkilerini haritalandırarak fazla yetkilendirme, gizli paylaşımlar, hatalı yapılandırmalar ve güven zincirlerindeki riskleri belirliyor. Böylece ajanlar devreye alınmadan önce maruziyet alanı daraltılıyor.

Ajanlar çalışmaya başladıktan sonra Prisma AIRS, davranışlarını gerçek zamanlı olarak izliyor ve ajanların araçlarla, API’lerle veya harici bileşenlerle kurduğu ilişkileri güvenlik açısından değerlendiriyor. Bu sayede yetki yükseltme girişimleri, bağlam manipülasyonları, bellek müdahaleleri, veri sızıntıları ve kötüye kullanım davranışları henüz operasyonel süreçleri etkilemeden engellenebiliyor. Platform ayrıca yönetilen bir Prisma AIRS MCP Server da sunuyor; bu sayede güvenlik kontrolleri doğrudan ajan iş akışlarının içine entegre edilebiliyor.

AI Model Güvenliği: Açık Kaynak Model Dağıtımlarında Yeni Güvenlik Katmanı

Kuruluşlar, açık kaynak modelleri kendi verileriyle eğitip üretime aldıkça, güvenlik açısından geleneksel yaklaşımların kapsayamadığı yeni bir saldırı yüzeyini de beraberinde getiriyor. Geleneksel güvenlik araçları, yazılım paketleri, konteyner imajları veya dosya sistemleri üzerinde çalışmak üzere tasarlandığı için yapay zekâ modellerinin dinamik ve katmanlı mimarisini tam olarak inceleyemiyor.

Prisma AIRS AI Model Security, modellerin iç yapısını analiz ederek zararlı kod çalıştırma girişimlerini, derin katmanlara yerleştirilmiş arka kapıları ve model kökenini (provenance) etkileyen bütünlük sorunlarını üretime çıkmadan önce tespit ediyor. Platform, Advanced WildFire tehdit istihbaratı ve 18.000 kişilik küresel Huntr araştırma topluluğundan elde edilen bilgilerle besleniyor. Şu anda milyonlarca modeli tarıyor, 25’ten fazla farklı tehdit kalıbını tanımlayabiliyor ve 20’den fazla model formatını güvence altına alabiliyor.

Bu yetenekler, MLOps ve CI/CD süreçlerine API-first yaklaşımı ile entegre şekilde sunuluyor. Böylece güvenlik, model yaşam döngüsünün başından sonuna kadar otomatik ve kesintisiz bir şekilde uygulanıyor.

AI Red Teaming: Sürekli, Otonom ve Bağlamsal Zafiyet Testleri

Yapay zekâ sistemleri, dilin manipülasyon gücüne açıktır. Modeller, yanlış yönlendirilecek şekilde ikna edilebilir, hassas içerikleri açığa çıkarabilir veya zararlı çıktılar üretebilir. Bu nedenle yapay zekâ sistemlerinin güvenliğinin değerlendirilmesi, yalnızca statik taramalarla veya dönemsel güvenlik testleriyle yapılabilecek bir süreç değildir.

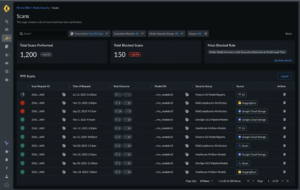

Prisma AIRS AI Red Teaming, geleneksel bir kerelik testlerin ötesine geçerek sürekli, otomatik ve bağlamsal güvenlik değerlendirmeleri gerçekleştirir. Hedeflenen modele ilişkin profil çıkarılır ve 500’den fazla özel saldırı senaryosu çalıştırılarak sistemin davranışı gerçek koşullar altında test edilir. Bulgular; NIST AI-RMF, OWASP ve MITRE gibi yerleşik güvenlik çerçeveleriyle eşlenir ve her bir sonuç için uygulamaya dönük düzeltme rehberi sunulur.

Bu yaklaşım, kurumların güvenlik açıklarını tespit etmesini, düzeltmesini ve ardından yeni sürümleri hızla yeniden test etmesini mümkün kılar. Böylece güvenlik, yapay zekâ geliştirme döngüsünün doğal ve sürekli bir parçası haline gelir.

Prisma AIRS™ 2.0 ile Güvenle İnovasyon

Flex kredi müşterileri Prisma AIRS’i doğrudan müşteri portalından devreye alabilir. Daha fazla bilgi almak veya bu eşsiz çözümü en iyi danışmanlıkla deneyimlemek için info@quasys.com.tr’den bize her zaman ulaşabilirsiniz.